Versuchsplanung

Leitung: Prof. Dr. Holger Dette

Mitglieder:

- Robin Solinus

Beschreibung:

In vielen Fällen kann die Effizienz von statistischen Untersuchungen durch eine optimale Wahl der Versuchsbedingungen deutlich verbessert werden. Typische Beispiele sind die Verteilung von Probanden in einer klinischen Studie auf verschiedene Therapieformen oder die Bestimmung einer Dosiswirkungskurve eines neuen Medikamentes, in der Probanden unter verschiedenen Dosierungen behandelt werden können. In der Arbeitsgruppe "Optimale Versuchsplanung" werden mathematische Verfahren entwickelt, um für solche und andere Fragestellungen optimale Versuchspläne zu bestimmen. Diese Probleme lassen sich mathematisch als Optimierungsprobleme für nichtlineare Funktionale mit unendlich dimensionalem Definitionsbereich formulieren. Das Ziel der Forschungsarbeiten besteht dann in der Charakterisierung von Lösungen solcher Probleme.

Funktionale Daten

Leitung: Dr. Holger Dette

Mitglieder:

- Dr. Lujia Bai

- Dr. Marius Kroll

- Dr. Sebastian Kühnert

- Pascal Quanz

- Bufan Li

Beschreibung:

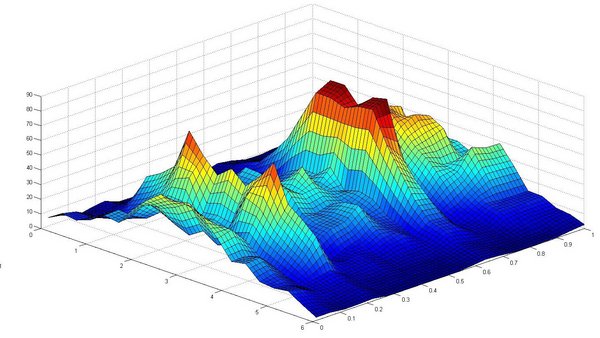

In der statistischen Praxis ist es häufig von Interesse, die Entwicklung einer bestimmten Größe in Abhängigkeit von der Zeit zu untersuchen. Diskret beobachtet werden solche Datensätze als Zeitreihen bezeichnet. Typische Beispiele finden sich etwa in der empirischen Ökonomie (Entwicklung von Preisen) oder in den Biowissenschaften (Wachstum eines Lebewesens), und bereits einfache Situationen legen nahe, dass die Untersuchung derartiger Zeitreihen methodisch deutlich über den klassischen Fall unabhängig, identisch verteilter Zufallsvariable hinausgeht. Im Fall der Unabhängigkeit ist das fast immer der Fall, da der Wert oder der Zuwachs der Zeitreihe in der Regel stark von jenen in der unmittelbaren Vergangenheit abhängt. Von der identischen Verteilung abzusehen ist weniger zwangsläufig, da es oft angemessen ist, mit Modellen zu arbeiten, die ein zeitlich homogenes ("stationäres") Verhalten voraussetzen. Es existieren jedoch auch Modelle, die Phasen stärkeren und schwächeren Wachstums oder allgemein (etwa jährliche) periodische Schwankungen von Kenngrößen wie Mittelwerten oder Quantilen miteinbeziehen. Diese verschiedenen Facetten der Periodizität einer Zeitreihe zu analysieren, ist ein Schwerpunkt, dem sich die Arbeitsgruppe "Zeitreihen" widmet. Daneben entwickeln wir Verfahren zur Modellvalidierung, d. h. wir überprüfen, inwieweit ein spezifisches Modell für eine konkrete Zeitreihe angemessen ist. Methodisch gehen wir dabei so vor, dass wir geeignete Abstandsmaße definieren und statistische Tests auf möglichst eleganten empirischen Versionen aufbauen.

Inverse Probleme

Leitung: Prof. Dr. Nicolai Bissantz

Mitglieder:

- Dr. Patrick Bastian

Beschreibung:

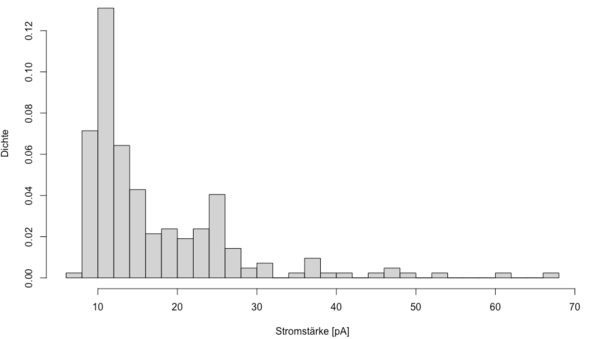

Ein Inverses Problem liegt vor, wenn die Groesse, der das Interesse des Beobachters gilt, nicht direkt messbar ist. Ein typisches Beispiel ist das der Faltung, die zum Beispiel bei optischen Beobachtungen mit Teleskopen in der Astronomie auftritt. Physikalische Grundeigenschaften der Ausbreitung von Licht und der Beugung an Oberflaeche wie zum Beispiel der Spiegel und Linsen des Teleskops fuehren hier dazu, dass ein punktfoermiges Objekt nicht als Punkt, sondern in Form einer Art Scheibchen beobachtet wird. Diese "Verschmierung" des Bilds kann mathematisch als Faltung des wahren Bilds mit der sogenannten Punktverbreitungsfunktion dargestellt werden. Die Rekonstruktion des wahren Bilds aus dem beobachteten, gefalteten Bild ist somit ein inverses Problem. Bei der Rekonstruktion des Bildes tritt nun das fuer inverse Probleme charakteristische Problem auf, dass Beobachtungsfehler zu beliebig grossen Fehlern im rekonstruierten Bild fuehren koennen. Der Umgang mit diesem Problem steht im Zentrum der statistischen Probleme bei inversen Problemen. In der Arbeitsgruppe Inverse Probleme beschaeftigen wir uns mit statistischen Verfahren zur Rekonstruktion solcher Daten (insbesondere fuer den Fall der Faltung) sowie mit statistischer Inferenz fuer solche Probleme.

Zufällige Matrizen

Leitung:

- Prof. Dr. Holger Dette

Mitglieder:

- Thomas Lam

Beschreibung:

In der Wahrscheinlichkeitstheorie und der Statistik versteht man unter einer zufälligen Matrix eine matrixwertige Zufallsvariable. Viele wichtige Eigenschaften in der Physik werden durch zufällige Matrixmodelle mathematisch modelliert (z.B. die Wärmeleitfähigkeit eines kristallinen Festkörpers oder ungeordnete physikalische Systeme). In der Arbeitsgruppe werden Eigenschaften des zufälligen Spektrums solcher Matrizen bei wachsender Dimension untersucht. Von besonderem Interesse sind dabei Beziehungen zu asymptotischen Nullstellenverteilungen von orthogonalen Polynomen, die ähnliche Eigenschaften haben wie die Eigenwertverteilungen zufälliger Matrizen.

Modellwahl und Goodness-of-Fit

Leitung: Prof. Dr. Nicolai Bissantz

Mitglieder:

- Dr. Lujia Bai

- Dr. Patrick Bastian

- Dr. Marius Kroll

- Pascal Quanz

- Bufan Li

Beschreibung:

Bei realen Datensätzen ist in der Regel nicht klar, auf welchem Wege die Daten generiert wurden. Der Statistiker steht jedoch vor der Aufgabe, ein Modell an die Daten anzupassen, welches die Hauptcharakteristika bestmöglich widerspiegelt und möglichst exakte Vorhersagen ermöglicht. Ein Modellwahlverfahren unterstützt den Statistiker vor der eigentlichen Datenanalyse bei der Entscheidung für ein möglichst gut passendes Modell. Ein typisches Problem welches durch die Modellwahl gelöst wird ist die Identifizierung relevanter Kovariablen in einem Regressionsmodell. Z.B. ist es von Interersse, bei einer bestimmten biologischen Eigenschaft herauszufinden, welche Gene Einfluss auf die Phänotypsausprägung haben. Mittels Modellwahlverfahren lassen sich die relevanten Gene ermitteln und anschließend der Zusammenhang zwischen diesen Genen und der Phänotypsausprägung beschreiben.

Durch Goodness-of-fit-Tests lassen sich unterschiedliche statistische Verfahren bezüglich der Güte ihrer Anpassung an die Daten vergleichen. Sind z.B. relevante Gene identifiziert, lässt sich eine lineare und eine nicht-parametrische Kurve zur Vorhersage einer Phänotypsausprägung bei einem gegebenen genetischen Profil anpassen. Welches Verfahren Vorteile birgt, kann durch einen Test auf parametrische Form ermittelt werden.

In der Arbeitsgruppe "Modellwahl und Goodness-of-fit" werden sowohl eher klassische Modellwahlverfahren entwickelt und ihre Eigenschaften untersucht, als auch modernere Methoden, wie bestrafte parametrische Regression. Es werden zudem neue Tests zum Vergleich von Regressionskurven entwickelt.

Biostatistik

Leitung: Prof. Dr. Holger Dette

Mitglieder:

- Dr. Patrick Bastian

- Zoe Kristin Lange

Differential Privacy

Leitung: Prof. Dr. Holger Dette

Mitglieder:

- Dr. Önder Askin

- Dr. Martin Dunsche

- Dr. Carina Graw

Beschreibung:

In der Statistik wird häufig mit sensiblen Daten gearbeitet. Daraus resultiert die Gefahr, dass aus statistischen Analysen die Privatsphäre von Individuen gefährdet wird. Typische Ansätze wie Anonymisierungen haben durch die rapide Weiterentwicklung von künstlicher Intelligenz an Bedeutung verloren und es hat sich eine neue Methode der Privatisierung durchgesetzt, nämlich Differential Privacy. Konzeptionell garantiert Differential Privacy einem jeden Individuum, dass es als Teilnehmer einer Datenanalyse (z.B. Statistik, maschinelles Lernen) nicht identifiziert werden kann. Die Grundlage des Erfolgs ist dabei die mathematische Formalisierung und Weiterentwicklung dieses Konzeptes. Die Arbeitsgruppe „Differential Privacy“ interessiert sich dafür, ob bisherige statistische Methoden, im Kontext von Differential Privacy, anwendbar bleiben. Exemplarisch interessiert man sich etwa für die Wechselwirkung von Privatsphäre und statistischer Genauigkeit.